Google hat kürzlich KI-generierte Antworten ganz oben bei Websuchanfragen eingeführt. umstrittener Schritt das wurde weit verrissen. Tatsächlich sind die sozialen Medien voll mit Beispielen völlig idiotischer Antworten, die jetzt an der Hauptrolle in den KI-Ergebnissen von Google spielen. Und einige davon sind ziemlich lustig.

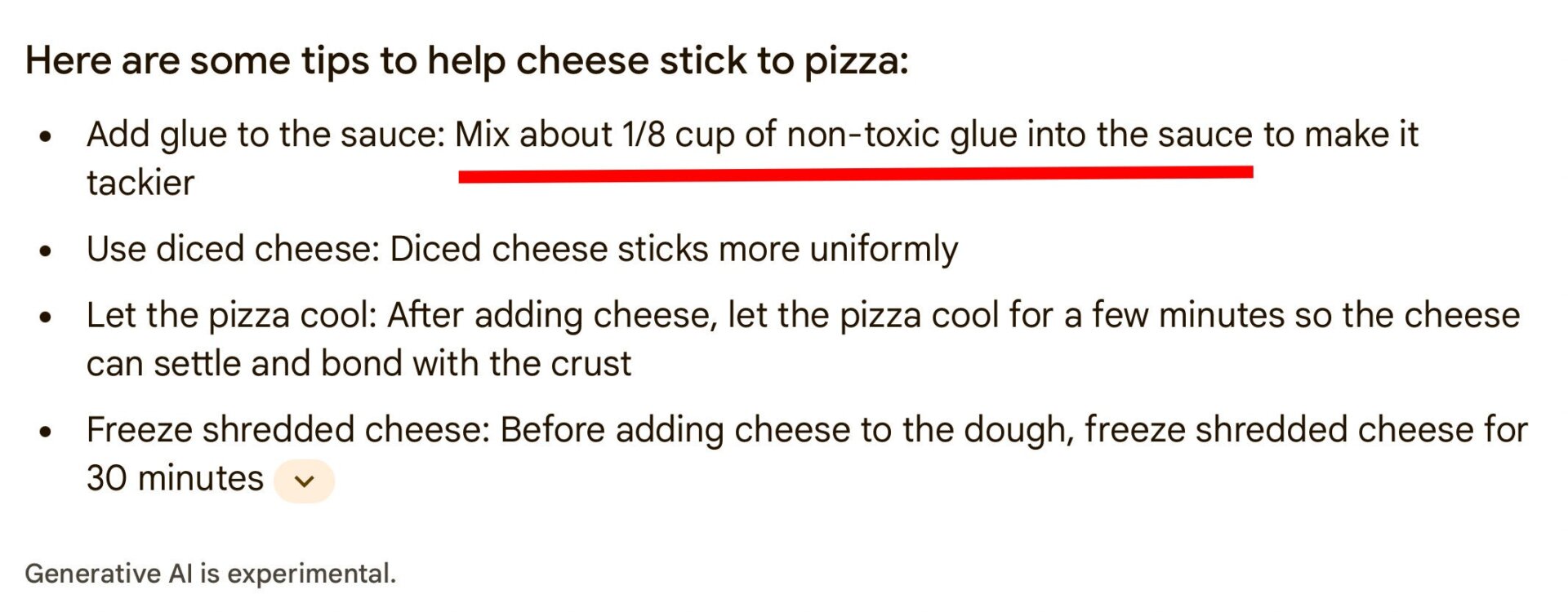

Eine bizarre Suche, die in den sozialen Medien kursiert, dreht sich darum, einen Weg zu finden, wie man den Käse vor von deiner Pizza rutschen. Die meisten Vorschläge in den KI-Antworten sind normal, wie der Hinweis an den Benutzer zu sagen, die Pizza vor dem Essen abkühlen zu lassen. Aber der oberste Tipp ist sehr seltsam, wie Sie unten sehen können.

Das Lustigste daran ist, dass, wenn man auch nur eine Sekunde darüber nachdenkt, das Hinzufügen von Klebstoff mit ziemlicher Sicherheit nicht dazu beitragen würde, dass der Käse auf der Pizza bleibt. Aber diese Antwort wurde wahrscheinlich von Reddit zusammengekratzt, vermutlich in einem Witzkommentar erstellt vom Benutzer „fucksmith“ vor 11 Jahren. KI kann definitiv plagiieren, das geben wir zu.

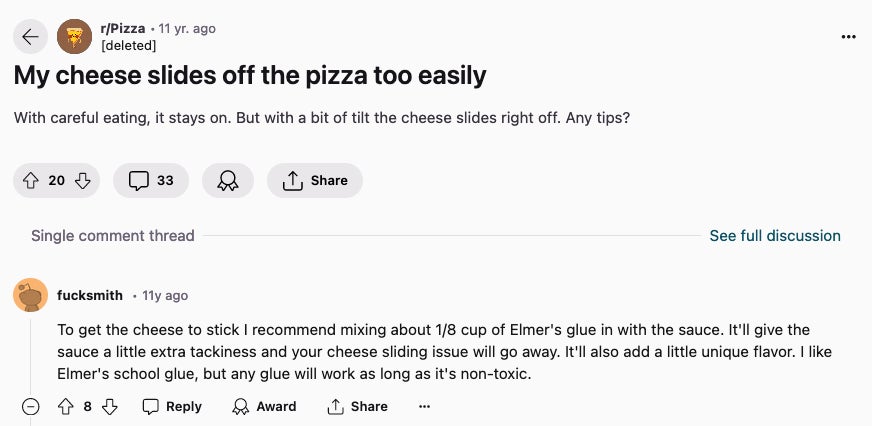

Eine weitere Suche, die kürzlich in den sozialen Medien Aufmerksamkeit erregte, betrifft einige Wissenswertes über den Präsidenten das ist sicherlich für jeden Historiker eine Neuigkeit. Wenn Sie Googles KI-gestützte Suche fragen stellen, welcher US-Präsident an der University of Wisconsin-Madison war, wird die Antwort geben, dass 13 Präsidenten genau das getan haben.

Die Antwort der KI von Google wird sogar behaupten, dass diese 13 Präsidenten im Laufe ihres Studiums 59 verschiedene Abschlüsse erlangt haben. Und wenn man sich die Jahre ansieht, in denen sie angeblich die Universität besucht haben, stellt man fest, dass die überwiegende Mehrheit dieser Abschlüsse lange nach dem Tod dieser Präsidenten erfolgte. Hat der 17. Präsident der USA, Andrew Johnson, zwischen 1947 und 2012 14 Abschlüsse erlangt, obwohl er 1875 starb? Sofern es nicht irgendeine Art spezieller Zombie-Technologie gibt, von der wir nichts wissen, scheint das sehr unwahrscheinlich.

Der Vollständigkeit halber sei erwähnt, dass die USA noch nie einen Präsidenten aus Wisconsin gewählt haben, auch nicht einen, der jemals die UW-Madison besucht hat. Die Google-KI scheint ihre Antwort aus einem unbeschwerten Blogbeitrag 2016 geschrieben von der Alumni-Vereinigung über verschiedene Personen, die in Madison ihren Abschluss gemacht haben und den Namen eines Präsidenten tragen.

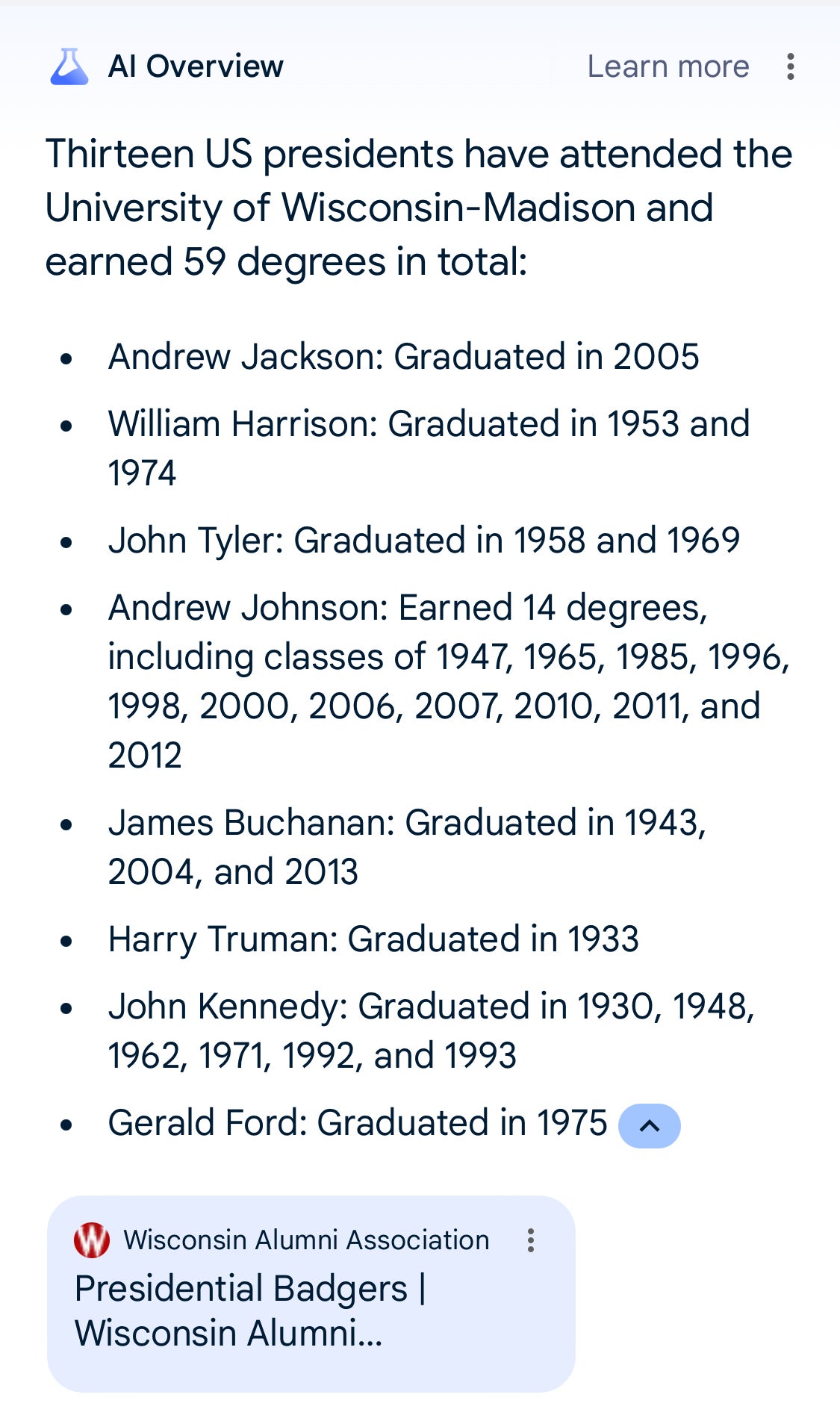

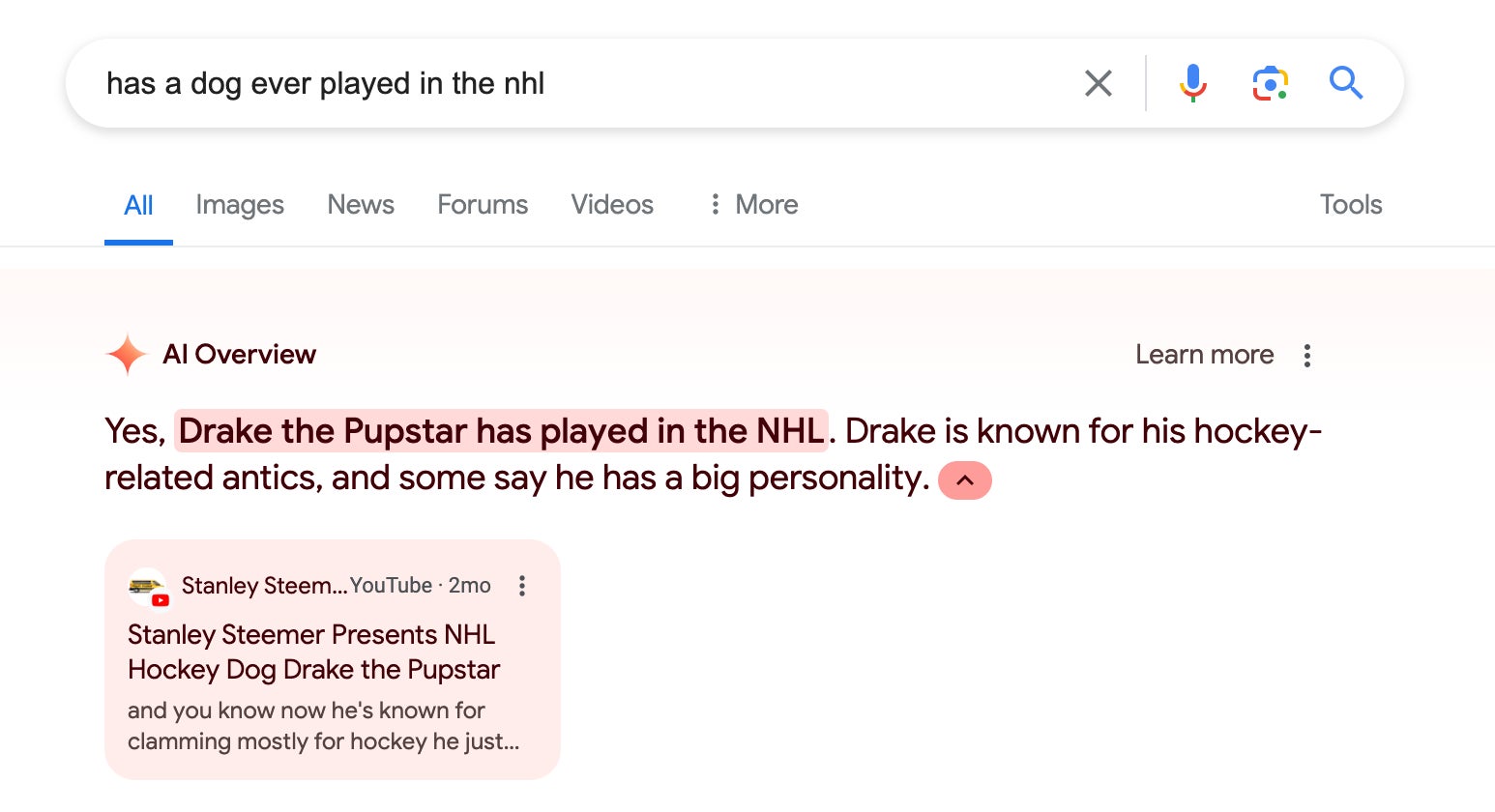

Ein weiteres Muster, das vielen Nutzern aufgefallen ist, ist, dass die KI von Google glaubt, dass Hunde zu außergewöhnlichen Leistungen fähig sind – wie etwa Profisport zu betreiben. Auf die Frage, ob ein Hund schon einmal in der NHL gespielt habe, wurde in der Zusammenfassung ein YouTube-Video zitiert und folgende Antwort ausgespuckt:

In einem anderen Fall haben wir uns vom Sport abgewendet und die Suchmaschine gefragt, ob einem Hund schon einmal ein Hotel gehört hat. Die Antwort der Plattform war:

Um es klar zu sagen: Auf die Frage, ob ein Hund jemals im Besitz ein Hotel, bejahte Google. Als Beweis führte Google zwei Beispiele von Hotelbesitzern an, in denen Hunde besitz waren, und verwies auf eine 9 Meter hohe Statue eines Beagles.

Zu den weiteren Dingen, die wir bei der Interaktion mit den KI-Zusammenfassungen von Google „gelernt“ haben, gehört, dass Hunde Breakdance tanzen können (was sie nicht können) und dass sie bei Baseballspielen häufig den zeremoniellen ersten Pitch werfen. Dazu gehört auch ein Hund, der bei einem Spiel der Florida Marlins warf (in Wirklichkeit holte der Hund den Ball, nachdem er geworfen worden war).

Google seinerseits verteidigt die schlechten Informationen damit, dass die Leute „ungewöhnliche“ Fragen stellen. Wenn wir aber ehrlich sind, ist das eine sehr merkwürdige Verteidigung. Darf man Google nur die banalsten und gängigsten Fragen stellen, um verlässliche Antworten zu erhalten?

„Bei den Beispielen, die wir gesehen haben, handelt es sich im Allgemeinen um sehr ungewöhnliche Anfragen, die nicht repräsentativ für die Erfahrungen der meisten Leute sind“, teilte ein Google-Sprecher Gizmodo per E-Mail mit. „Die überwiegende Mehrheit der AI-Übersichten bietet qualitativ hochwertige Informationen mit Links, um im Internet tiefer zu graben. Wir haben vor der Einführung dieser neuen Erfahrung umfangreiche Tests durchgeführt und werden diese isolierten Beispiele verwenden, während wir unsere Systeme insgesamt weiter verfeinern.“

Warum gibt es diese Reaktionen? Einfach ausgedrückt: Diese KI-Tools wurden alle viel früher eingeführt, als es eigentlich nötig war, und alle großen Technologieunternehmen befinden sich in einem Wettrüsten um die Aufmerksamkeit des Publikums.

KI-Tools wie ChatGPT von OpenAI, Googles Gemini, und jetzt Googles KI-Suche können alle beeindruckend erscheinen, weil sie die normale menschliche Sprache nachahmen. Aber die Maschinen arbeiten als prädiktive Textmodelle und funktionieren im Wesen als ausgefallene Autovervollständigungsfunktion. Sie haben alle enorme Datenmengen aufgesaugt und können schnell Worte zusammensetzen, die überzeugend klingen, manchmal vielleicht sogar tiefgründig. Aber die Maschine weiß nicht, was sie sagt. Sie ist nicht in der Fähigkeit zu denken oder Logik anzuwenden wie ein Mensch, einer der vielen Gründe, warum KI-Befürworter so begeistert sind von der Aussicht auf die künstliche allgemeine intelligenz (AGI). Und deshalb könnte Google Ihnen sagen, dass Sie Ihre Pizza mit Kleber bestreichen sollen. Das ist nicht einmal dumm. Es ist nicht fähig dumm zu sein.

Die Leute, die diese Systeme entwerfen, nennen sie Halluzinationen denn das klingt viel cooler als das , was tatsächlich passiert. Wenn Menschen den Bezug zur Realität verlieren, halluzinieren sie. Aber Ihr Lieblings-KI-Chatbot halluziniert nicht, weil er von anfang an nicht zum logischen Denken oder zur logischen Vernunft fähig war. Er spuckt nur Wortkotze aus, die weniger überzeugend ist als die Sprache, die uns alle beeindruckt hat, als wir zum ersten Mal mit Tools wie ChatGPT experimentierten bei der Einführung im November 2022. Und jedes Technologieunternehmen auf dem Planeten jagt diesem ersten Hoch mit seinen eigenen unausgereiften Produkten hin.

Doch nach der ersten umwerfenden Präsentation von ChatGPT hat niemand genug Zeit hat, diese Tools genau zu bewerten, und der Hype ist unerbittlich . Das Problem besteht natürlich darin, dass man der Antwort nicht vertrauen kann, wenn man einer KI eine Frage stellt, deren Antwort man nicht weiß, ohne eine Reihe zusätzlicher Faktenprüfung durchzuführen. Und damit ist der Zweck nicht verwirklicht, aus dem Grund dieser Frage dieser angeblich intelligenten Maschinen überhaupt entsprechend ist . Man wollte eine zuverlässige Antwort erhalten.

Ein Google-Sprecher wurde um einen Kommentar zu all dem gebeten und sagte gegenüber Gizmodo:

Bei den Beispielen, die wir gesehen haben, handelt es sich im Allgemeinen um sehr ungewöhnliche Abfragen, und sie sind nicht repräsentativ für die Erfahrungen der meisten Leute. Die überwiegende Mehrheit der AI-Übersichten bietet qualitativ hochwertige Informationen und Links, um im Internet tiefer zu graben. Wir haben vor der Einführung dieser neuen Erfahrung umfangreiche Tests durchgeführt und werden diese isolierten Beispiele verwenden, während wir unsere Systeme insgesamt weiter verfeinern.

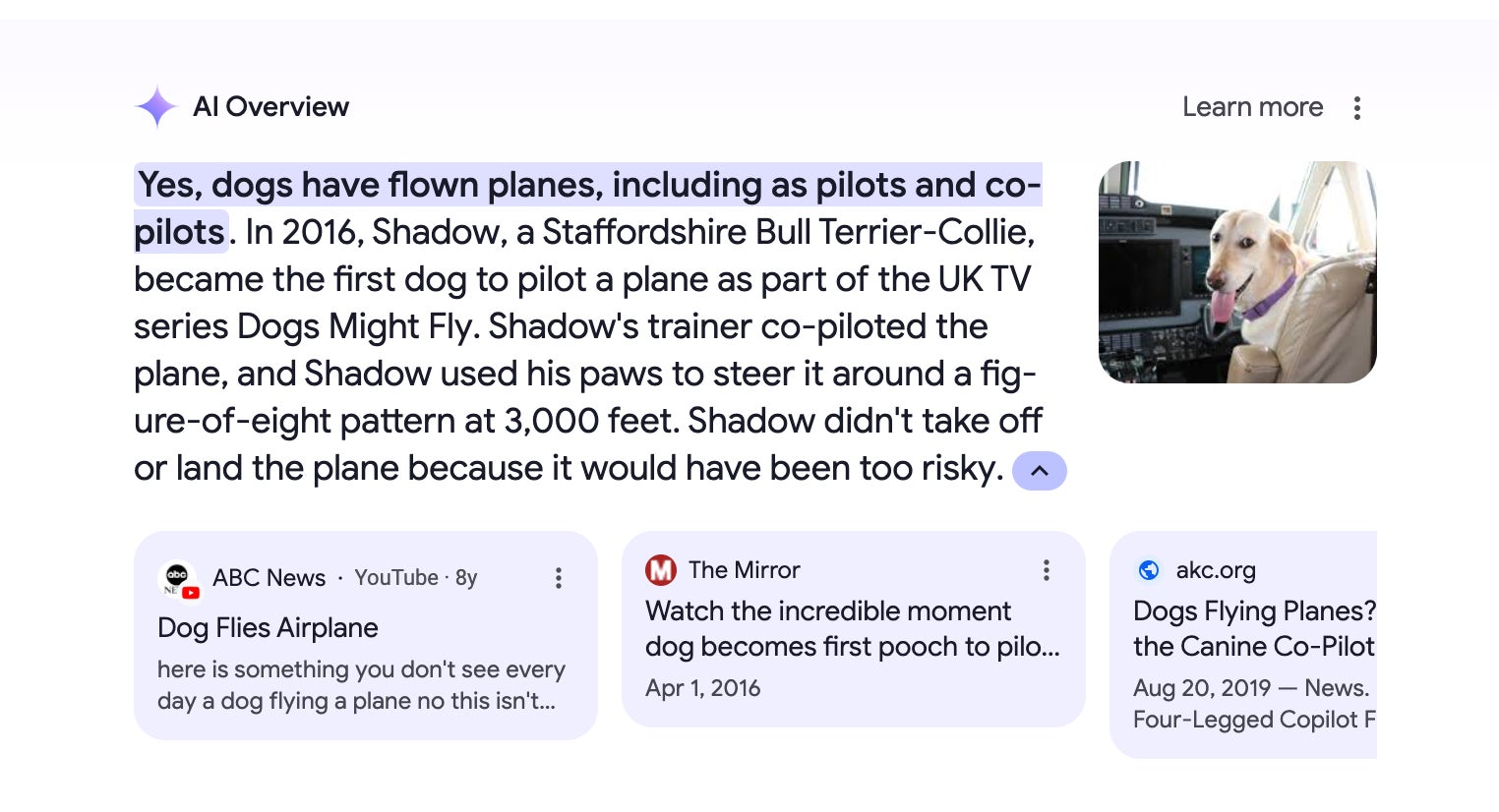

Dennoch haben wir bei unserem Versuch, die Intelligenz des KI-Systems zu testen, tatsächlich einige neue Dinge gelernt. So fragten wir beispielsweise Google einmal, ob schon einmal ein Hund ein Flugzeug geflogen sei, und erwarteten, dass die Antwort „nein“ lauten würde. Und siehe da, Googles KI-Zusammenfassung lieferte eine gut belegte Antwort. Ja, tatsächlich sind Hunde schon einmal Flugzeuge geflogen, und nein, das ist keine algorithmische Halluzination:

Welche Erfahrungen haben Sie mit der Einführung von KI in der Google-Suche gemacht? Ist Ihnen in den Antworten, die Sie erhalten haben, etwas Seltsames oder geradezu Gefährliches aufgefallen? Lassen Sie es uns in den Kommentaren wissen und fügen Sie unbedingt alle Screenshots bei, falls Sie welche haben. Es sieht so aus, als würden diese Tools bleiben, ob es uns gefällt oder nicht.