Die Softwareentwicklerin Ibtihal Aboussad, laut LinkedIn-Profil Teil des AI Platform-Teams von Microsoft, warf Suleyman während seines Vortrags öffentlich Kriegsprofiteertum vor. „Schämt euch!“, rief sie. „Ihr nutzt AI für Völkermord in unserer Region. Ihr habt Blut an den Händen. Wie könnt ihr feiern, wenn Microsoft Kinder tötet?“

Interner Protest gegen milliardenschwere AI-Verträge

Nach der Unterbrechung wurde Aboussad von Sicherheitskräften aus dem Saal geführt. Anschließend verschickte sie laut Medienberichten eine interne Mitteilung an mehrere Verteiler innerhalb des Unternehmens. Darin kritisiert sie offen Microsofts Rolle in der aktuellen Eskalation im Nahen Osten, insbesondere die Zusammenarbeit mit dem israelischen Militär.

Die Zahlen, auf die sie sich stützt, sind brisant: Microsoft unterhält laut Aboussad einen Vertrag über 133 Millionen Dollar mit dem israelischen Verteidigungsministerium. Seit dem Angriff der Hamas am 7. Oktober 2023 habe die Nutzung von Microsoft- und OpenAI-Produkten durch das israelische Militär um das 200-fache zugenommen. Die auf Microsoft-Servern gespeicherten Datenmengen seien bis Juli 2024 auf über 13,6 Petabyte angewachsen.

Noch schwerer wiegt laut Aboussad der Vorwurf, Microsoft-Technologie würde sensible, hochgeheime militärische Projekte unterstützen – darunter das sogenannte „Target Bank“-System zur Zielauswahl sowie das palästinensische Bevölkerungsregister. Beides wird genutzt, um Angriffe in Gaza gezielt zu planen und durchzuführen.

Microsoft: „Alle Stimmen sollen gehört werden – ohne Störung“

Das Unternehmen reagierte mit einem knappen Statement. Ein Sprecher erklärte: „Wir bieten viele Möglichkeiten, unterschiedliche Stimmen zu hören. Wichtig ist dabei, dass dies ohne geschäftliche Störungen geschieht. Kommt es dennoch dazu, bitten wir die Beteiligten, sich zurückzuziehen. Wir sind weiterhin bestrebt, höchste Standards in unserem Geschäftsgebaren zu wahren.“

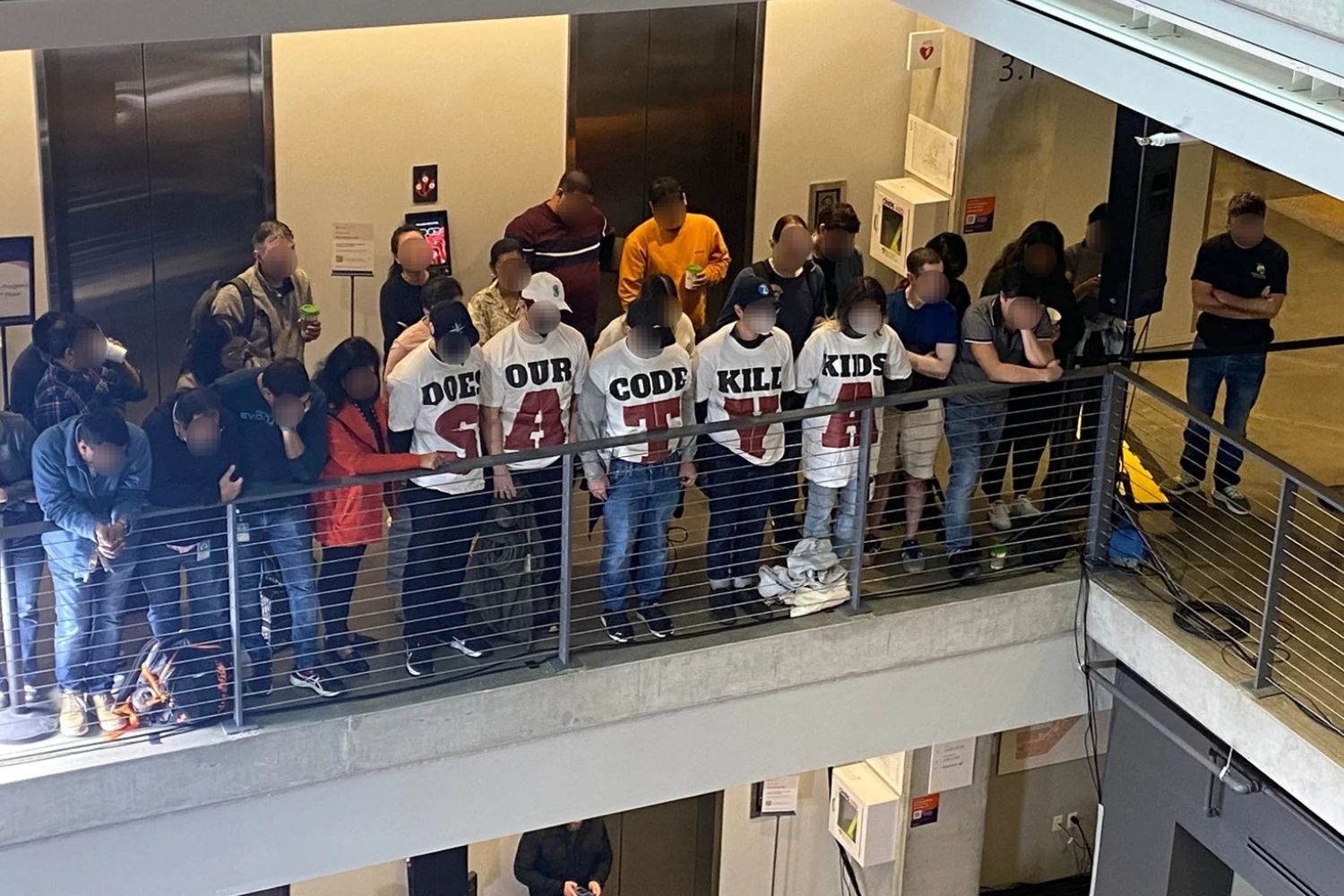

Für viele Beobachter klingt das eher nach Schadensbegrenzung. Denn Microsoft steht mit der Kritik nicht allein da: Bereits im Februar protestierten fünf weitere Mitarbeitende während einer internen Veranstaltung, indem sie mit T-Shirts den Satz formten: „Does our code kill kids?“ (Tötet unser Code Kinder?)

Eine Branche im Spannungsfeld zwischen Ethik und Profiten

Die Beziehung zwischen Tech-Industrie und Militär ist seit Jahren ein sensibles Thema. Viele Mitarbeitende großer Konzerne wie Google, Meta oder Microsoft haben sich in der Vergangenheit gegen die militärische Nutzung ihrer Arbeit ausgesprochen. Doch spätestens seit dem Ukraine-Krieg und den wachsenden Spannungen im Südchinesischen Meer hat sich der Wind gedreht: Verteidigungsaufträge gelten wieder als strategisch – und lukrativ.

Firmen wie Palantir und Anduril florieren gerade deshalb. Gleichzeitig verloren viele Beschäftigte in klassischen Tech-Unternehmen durch Massenentlassungen an Einfluss. Die Entscheidungsmacht liegt wieder stärker bei den Führungsetagen – kritische Stimmen werden zunehmend überhört oder, wie im Fall von Aboussad, aus Veranstaltungen entfernt.

„Ich wollte Technologie für das Gute entwickeln“

In ihrem Memo beschreibt Aboussad die Enttäuschung über den Wandel in der Branche. „Als ich ins AI Platform-Team wechselte, war ich begeistert, an Technologien mit echtem Nutzen für die Menschheit zu arbeiten – etwa bei Barrierefreiheit, Übersetzung oder Bildung. Niemand hat mir gesagt, dass meine Arbeit an das israelische Militär verkauft wird, um Journalist:innen, Ärzt*innen, Helfer:innen und ganze Familien zu überwachen und zu töten.“

Ein zentraler Kritikpunkt an militärischer AI-Nutzung ist die steigende Tendenz, sich blind auf algorithmische Vorschläge zu verlassen. Gerade aus Israel gibt es Berichte, wonach Soldaten Angriffsempfehlungen von KI-Systemen übernehmen, ohne sie manuell zu prüfen. Der sogenannte Signalgate-Skandal offenbarte zudem, wie willkürlich einige Angriffe abliefen: Ein Wohnhaus wurde bombardiert, weil sich dort die Freundin eines Zielobjekts aufhielt – ein klarer Verstoß gegen humanitäres Völkerrecht.

Und die Moral?

Auch Palmer Luckey, CEO des Rüstungsunternehmens Anduril, zeigt Verständnis für die Dilemmata von Tech-Angestellten: Viele hätten sich bewusst für Unternehmen wie Microsoft entschieden, um nützliche, zivile Anwendungen zu entwickeln – und fänden sich nun unverhofft in einer militärischen Realität wieder. Bei Firmen wie Anduril sei wenigstens von Anfang an klar, worauf man sich einlässt.

Microsoft steht damit erneut vor der Frage: Wie transparent geht man mit kritischen Verträgen um – und wie ernst nimmt man ethische Bedenken der eigenen Belegschaft? Denn eines ist klar: Die Proteste im eigenen Haus werden lauter. Und irgendwann reichen PR-Statements nicht mehr aus.