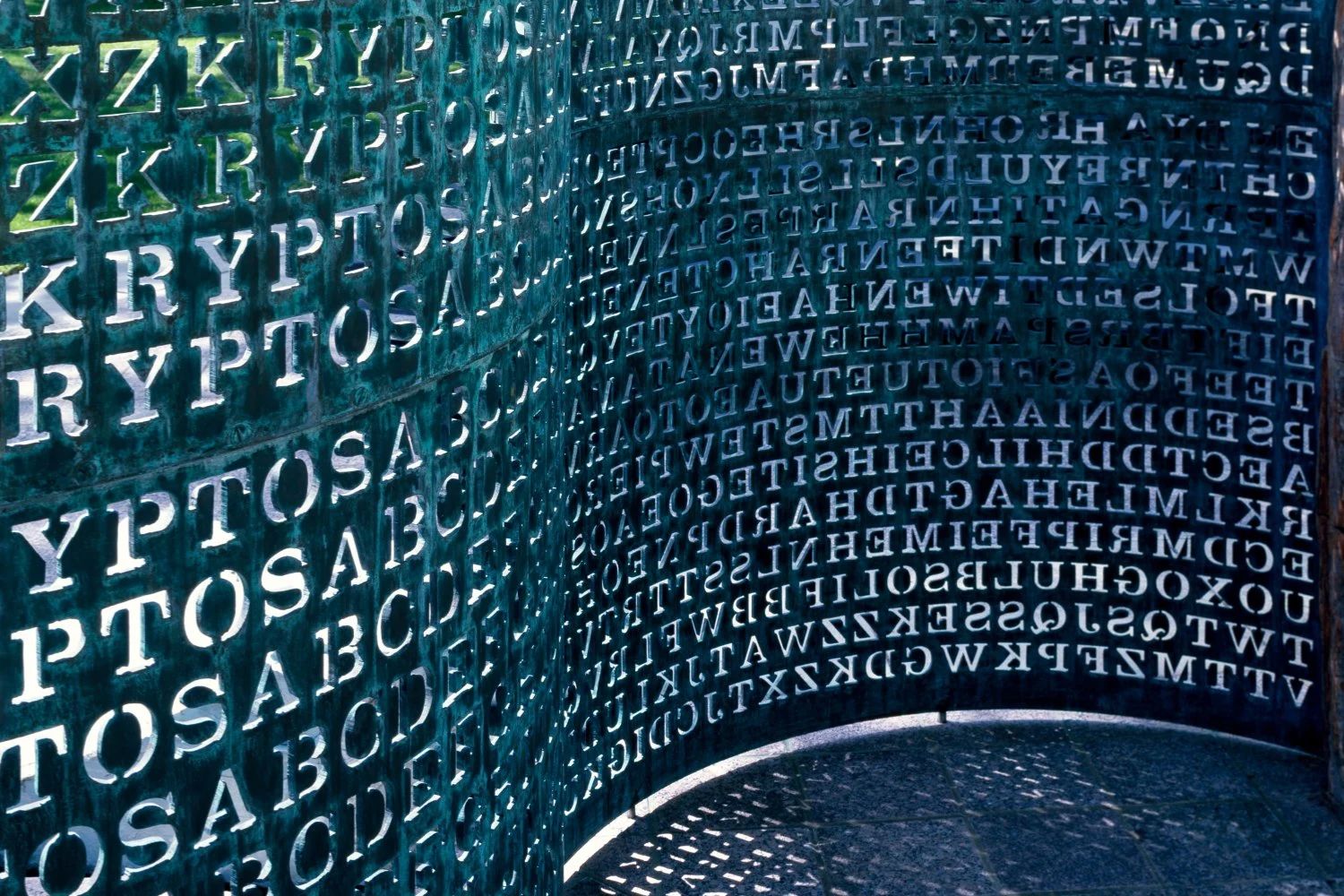

In der Nähe des Hauptquartiers der CIA in Langley, Virginia, steht eine Statue namens Kryptos. Sie ist seit 1990 dort und enthält vier geheime Codes – drei davon wurden bereits gelöst. Der letzte ist seit 35 Jahren nicht entschlüsselt worden. Und laut einem Bericht von Wired möchte der verantwortliche Bildhauer, dass jeder weiß, dass man das verdammte Ding nicht mit einem Chatbot lösen kann.

Jim Sanborn, der auch Skulpturen für das Massachusetts Institute of Technology und die National Oceanic and Atmospheric Administration geschaffen hat, hat Berichten zufolge eine Flut von Menschen erlebt, die sich absolut sicher sind, dass sie K4, das letzte ungelöste Panel des Codes, gelöst haben, den er mit kniffligeren Techniken kodiert hat. Aber diese Codeknacker sind nicht die tatsächlichen Kryptanalytiker, professionell oder anderweitig, die besessen davon sind, die Nachricht seit ihrem Erscheinen zu entschlüsseln. Nein, das sind einfach einige Leute, die den Code durch einen Chatbot laufen ließen und dessen Antwort als Lösung akzeptiert haben.

In einem Gespräch mit Wired sagte Sanborn, dass er einen signifikanten Anstieg der Einsendungen festgestellt hat, was bereits ärgerlich ist, wenn man schon 79 Jahre alt ist und in den letzten dreieinhalb Jahrzehnten so viele Einsendungen erhalten hat, dass er eine Gebühr von 50 Dollar für die Überprüfung von Lösungen erheben musste, da er über die Jahre so viele Spinner kontaktiert hat. Aber schlimmer als nur die Häufigkeit der Einsendungen ist laut Sanborn die Einstellung der Einsender.

„Der Charakter der E-Mails ist anders – die Leute, die ihren Code mit KI geknackt haben, sind total überzeugt, dass sie Kryptos beim Frühstück geknackt haben“, sagte er zu Wired. „Also sind sie sich alle sehr sicher, dass sie, bis sie zu mir kommen, es geknackt haben.“

Hier sind nur einige Beispiele für die äußerst arroganten und selbstzufriedenen Nachrichten, die Sanborn in den letzten Jahren erhalten hat:

„Ich bin nur ein Veteran… Habe es in wenigen Tagen mit Grok 3 geknackt.“

„Was 35 Jahre gedauert hat und selbst die NSA mit all ihren Ressourcen nicht konnte, konnte ich in nur 3 Stunden tun, bevor ich meinen Morgenkaffee hatte.“

„Die Geschichte wird neu geschrieben… keine Fehler, zu 100 % geknackt.“

Wenn du auch nur eine gewisse Zeit in sozialen Medien verbracht hast, insbesondere auf X, hast du diese Leute gesehen. Vielleicht nicht genau diese, aber genau die gleiche Art von Leuten. Du weißt schon, die, die sagen „Grok es einfach“ oder auf einen Beitrag eines anderen mit „Hier ist, was Grok sagt“, antworten oder einen Screenshot der Antwort von ChatGPT teilen, als wäre das in irgendeiner Weise eine Bereicherung für das Gespräch.

Die Selbstgefälligkeit ist, ehrlich gesagt, unerklärlich. Selbst wenn sie Sanborns Code erfolgreich mit KI geknackt hätten (was Sanborn übrigens sagt, dass sie nicht einmal nah dran waren), was ist es, dass es bei der Anfrage an eine Maschine, die Arbeit für dich zu machen, solch eine Selbstzufriedenheit hervorruft? Es wäre eine Sache, wenn sie ein großes Sprachmodell auf einer endlosen Menge von Verschlüsselungswissen trainiert und damit Sanborns Code geknackt hätten. Aber sie fragen buchstäblich nur einen Chatbot, sich ein Bild anzusehen und es zu lösen. Es ist das am wenigsten clevere, was man sich vorstellen kann. Es ist, als würde man auf die Rückseite des Lehrbuchs blättern, um die richtige Lösung für die Mathematikgleichung zu sehen, nur dass in diesem Fall das Lehrbuch die Antwort selbstbewusst halluciniert hat.

Dieses Verhalten ist eigentlich nicht ungewöhnlich. Eine im letzten Jahr veröffentlichte Studie im Journal Computers in Human Behavior stellte fest, dass Menschen, wenn sie erfahren, dass der Rat von KI generiert wurde, dazu neigen, sich zu sehr darauf zu verlassen und sogar erlaubt, dass sie gegen widersprüchliche kontextuelle Informationen und ihre eigenen Interessen verstoßen. Die gleiche Studie fand auch heraus, dass jemand, der sich zu sehr auf KI-Ratschläge verlässt, seine Interaktionen mit anderen Menschen negativ beeinflusst. Vielleicht liegt es daran, dass sie so verdammt zufrieden mit sich selbst sind.